“Con mi cara no”: alertan sobre el uso de reconocimiento facial en las calles argentinas

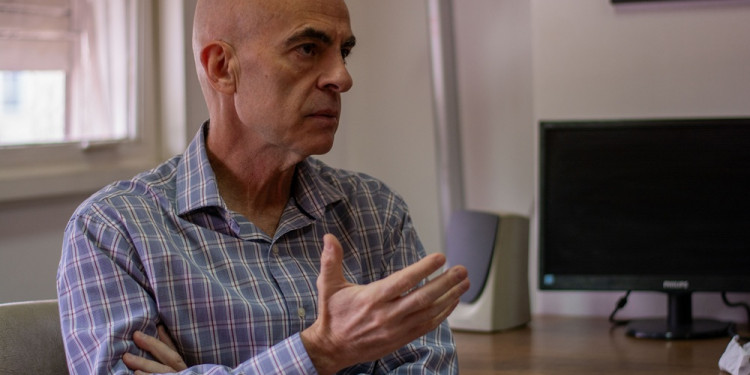

En Radio U hablamos con Eduardo Ferreyra, abogado de la Asociación por los Derechos Civiles, acerca de esta campaña creada para concientizar sobre la tecnología biométrica.

Foto: publicada por Infobae

Unidiversidad / Este Lejano Planeta

Publicado el 11 DE MAYO DE 2021

La distancia entre los ojos, la nariz y la boca, la forma de la oreja y el tono de piel son algunas de las características únicas de los seres humanos. Sin embargo, esta información personal sensible está siendo utilizada para identificar y autenticar de manera automática a uno o múltiples individuos en distintas ciudades de la Argentina, y Mendoza es una de ellas.

La Asociación por los Derechos Civiles (ADC), organización de la sociedad civil con más de 25 años de trayectoria en la defensa y promoción de los Derechos Humanos y Civiles en Argentina y la región, sostiene que esta tecnología impacta en los derechos de cada persona. Por eso están impulsando la campaña “Con mi cara no”, una iniciativa que busca concientizar sobre el reconocimiento facial.

Eduardo Ferreyra, abogado de la ADC, estuvo en comunicación con Este lejano Planeta (Radio U) y habló sobre esta iniciativa que busca concientizar sobre el reconocimiento facial, cómo funciona, cómo se procesan los datos biométricos y por qué los riesgos de su implementación son mayores que los potenciales beneficios. “Desde la Asociación por los Derechos Civiles, estamos llevando adelante esta campaña para informar a la gente sobre este despliegue de tecnología de reconocimiento facial que se está llevado a cabo en diferentes puntos de la Argentina, entre ellos Mendoza, como así también informar de sus riesgos y tomar conciencia sobre su exposición”, expresó Ferreyra.

La tecnología biométrica, afirmó Ferreyra, toma los rasgos de las personas, realiza un mapeo de las características físicas de la cara y genera una plantilla con la representación matemática para ese rostro único. Su propósito es comparar e indicar en tiempo real en qué porcentaje la plantilla de una cara captada por una cámara de videovigilancia se corresponde con las imágenes almacenadas en una base de datos predeterminada.

"Los datos biométricos están vinculados con la identidad y no se pueden reemplazar, ya que forman parte de quién es cada uno como persona, sus características y comportamientos. Esto implica que, ante una filtración de esas bases de datos, miles o millones de personas van a encontrarse vulnerables a potenciales abusos y daños personales, pero su problema radica en que es un sistema que no es infalible, ya que puede arrojar falsos positivos y discriminar por el tono de piel y el género de una persona. Para darte un ejemplo, en la Ciudad de Buenos Aires hubo gente que fue mal identificada y pasó hasta seis días presa en una celda de comisaria. Esto demuestra que esta tecnología tiene fallas", señaló el abogado.

Y sumó: “Te repito, estas tecnologías son un vehículo para la discriminación, ya que son imprecisas y pueden arrojar un porcentaje más alto de falsos positivos contra personas de tez no blanca y mujeres; de ahí se considera el sesgo racista. Esto ocurre a partir del entrenamiento del algoritmo del software, que tiene definida la precisión con la cual podrá reconocer rostros en diversos escenarios. Por ejemplo, cambios de luz, fondos con distintos colores o ángulos variados también pueden incidir en la certeza del reconocimiento. En esta instancia, aquellos aspectos sensibles como el tono de piel y el género de una persona juegan un rol crucial, dado que el software de reconocimiento facial puede discriminarlas, sea, por ejemplo, si confunde a una persona con otra por tener rasgos 'parecidos' solo por su tez, o incluso estigmatizando las identidades binarias y no binarias”.

En este momento, este sistema no está siendo utilizado en la búsqueda de personas desaparecidas o en situaciones que tengan que ver con la trata de personas. "Lo bueno sería que se lo implementara en esto (trata y desapariciones), pero lamentablemente se la está utilizando para la seguridad social que, como digo, trae riesgos. Ojo, no solo lo decimos nosotros, sino varias expresiones a nivel mundial como la ONU, relatores de libertad de expresión, incluso ciudades de los Estados Unidos como San Francisco o California han prohibido este tipo de tecnología para vigilancia", completó el abogado.

Escuchá la nota completa.

Audio

Entrevista con Eduardo Ferreyra

Abogado ADC

argentina, mendoza, identificación de rostro, videovigilancia, tecnologia, con mi cara no, eduardo ferreyra, asociación por los derechos civiles, este lejano planeta, radio u, ,

El trabajo y las tareas de cuidado reconfiguran la trayectoria académica en la universidad

En un contexto socioeconómico desafiante, la necesidad de trabajar, cuidar a otras personas y ...

07 DE MAYO DE 2026

Puro chamuyo: “No existe una mejor manera de hablar la lengua”

El lunfardo fue producto del choque entre lenguas por la ola inmigratoria alrededor de 1900. No ...

06 DE MAYO DE 2026

"Darle a un niño un celular con redes es como darle comida chatarra”

Así lo aseguró el neurocirujano Fabián Cremaschi. El profesor de la UNCUYO explicó lo que produce e ...

05 DE MAYO DE 2026