Si una IA te desnuda, hay plataformas que te ayudan a eliminar la imagen de internet

Casi la totalidad de los deepfakes se usan para crear pornografía de mujeres, y son mujeres 9 de cada 10 personas que sufren la difusión no consentida de material íntimo. La justicia no puede seguirles el ritmo a las agresiones digitales, pero algunas plataformas pueden limitar el daño, sean las víctimas niñas, adolescentes o adultas. Funcionan con imágenes reales, editadas o creadas con IA.

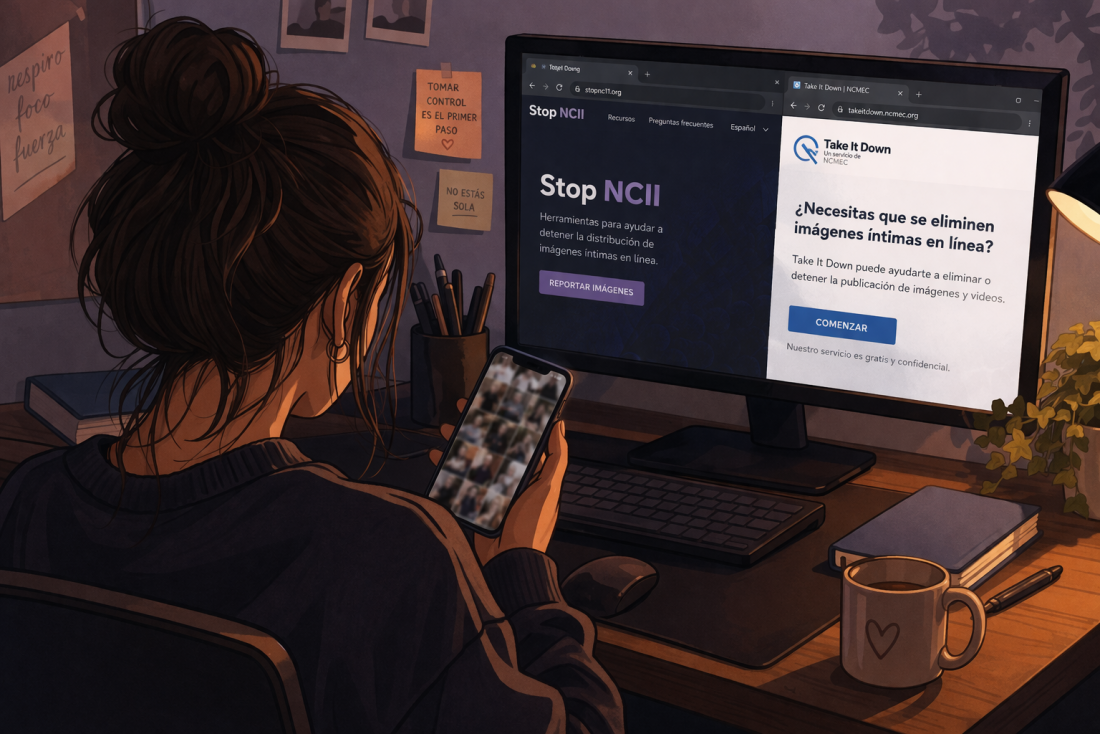

StopNCII y TakeItDown han dado de baja cientos de miles de fotos a pedido de las víctimas. Imagen generada con IA

La revolución digital es un hecho, y la violencia digital, también. Cada vez más mujeres y niñas son víctimas de la creación y difusión de imágenes o videos pornográficos con su cara mediante la manipulación de la IA. Ante el vacío legal contra la violencia de género digital, hay estrategias para ayudar a las víctimas a intentar ponerle un límite al daño: sitios web a través de los cuales las personas pueden eliminar de internet imágenes de desnudos creados con IA. Se trata de Stop NCII, para personas mayores de edad, y Take It Down, para menores de 18 años. No son infalibles, pero son efectivos.

Los deepfakes son videos e imágenes de desnudos creadas con inteligencia artificial. En el 98 % de los casos, son de contenido pornográfico y, en ese total, el 99 % de las víctimas son mujeres. Lo dice el informe "State of Deepfake 2023", de la empresa que analiza el panorama en Estados Unidos. ONU Mujeres ratifica que son mujeres 9 de cada 10 personas que sufren la difusión no consentida de material íntimo. Los casos aumentan y algunos toman relevancia en la agenda pública: sabemos de situaciones del entorno cercano y también de personas reconocidas en el país y el mundo.

En Argentina, la violencia digital es considerada una forma de violencia de género desde 2023, cuando se la incluyó mediante el proyecto de Ley Olimpia a la Ley 26485. En ese momento no se consiguió sancionar la Ley Belén, que busca penalizar los delitos de obtención y difusión no consentida de material sexual, íntimo o de desnudez; la sextorsión —extorsión con amenaza de exposición de material íntimo—, y el porn deep fake —montajes pornográficos hechos con inteligencia artificial—.

Poner un límite es imprescindible para frenar la extensión del daño. Las consecuencias de esta violencia son conocidas por casos como el de la adolescente Ema Bondaruk o la agente de policía Belén San Román, que se suicidaron luego de que se difundiera sin su consentimiento material íntimo o sexual de ellas.

Entonces, ¿qué hacer? En primer lugar, denunciar: el acoso, las amenazas, la extorsión y las lesiones son delitos. Ocurre que la justicia es lenta y no alcanza nunca el ritmo de la extensión del daño. Para eso, existen organizaciones sin fines de lucro con herramientas que permiten bajar el contenido. Para personas adultas, funciona Stop NCII (Stop Non-Consensual Intimate Imagen); para niñas y adolescentes, Take It Down (del National Center for Missing & Exploited Children).

Los sitios crean un hash (o huella digital) que se comparte con redes sociales, buscadores y otras plataformas para que sus sistemas detecten esa imagen y la retiren automáticamente. No hay que adivinar dónde está ni perseguirlas una por una. Funciona con imágenes reales, editadas o creadas con IA. Solo basta que se hayan difundido sin consentimiento de la persona implicada para rastrearse y bloquearse.

¿Cómo funcionan? Descargamos el contenido cuya difusión queremos limitar, creamos un caso y lo seleccionamos. Sin cargarlo en sus servidores, los sitios crean para esa imagen o video un hash o huella digital única de esa imagen o video íntimo. Todas las copias de ese contenido tienen exactamente el mismo marcador específico, por eso se le dice “huella digital”. Las plataformas comparten el hash con las empresas participantes (Meta, OnlyFans, PornHub, etc.) para que detecten y eliminen las imágenes o videos que coincidan con el hash, y eviten así que se compartan en línea.

Imágenes: estas son las empresas que participan en StopNCII, casi las mismas que en TakeItDown

El proceso es anónimo y gratuito. Hasta ahora, ha eliminado más de 200 mil imágenes íntimas no consentidas y tiene cerca del 90 % de efectividad, según dicen en sus plataformas. El servicio de estas plataformas se difundió masivamente en el último tiempo porque estas violencias van en aumento.

Un ejemplo es lo que pasa en X (ex-Twitter), que en 2025 presentó la función de generar imágenes a través de su IA, Grok. Las alarmas se encendieron porque, sin ningún reparo, el chatbot de Elon Musk responde a pedidos de creación de imágenes y videos sexualizados o manipulados de mujeres que, en algunos casos, son menores de 18 años. El año nuevo no hizo borrón y cuenta nueva. En enero de 2026, y durante una semana, fue tendencia la frase “Grok, poné en bikini a esta chica”, y la plataforma no puso límites, sino que decidió aprovechar para monetizar la función.

Paso a paso:

- Descargá la imagen (o el video). Guardala en tu teléfono o computadora. La necesitás para que el sistema pueda identificarla en internet;

- Entrá a StopNCII.org (si la persona es adulta) o a Take It Down (National Center for Missing & Exploited Children) si la persona es menor de edad;

- Dentro de la plataforma, creás un caso, subís la imagen desde tu dispositivo y confirmás que sos la persona afectada (o su tutor o tutora legal).

ia, violencia digital, deepfake,

Cuatro de cada diez pymes argentinas ya usan IA y la mayoría no redujo puestos de trabajo

La inteligencia artificial ya forma parte de sus procesos cotidianos para mejorar la productividad ...

26 DE MAYO DE 2026

De amigos a seguidores: qué cambió que pasamos a una actitud pasiva en redes sociales

Vemos más contenido en nuestras pantallas, pero es cada vez más extraño que esos contenidos sean de ...

14 DE MAYO DE 2026

Desafíos en tiempos de IA: “Nuestra mayor rebeldía es prestar atención”

Así lo aseguró el filósofo Tomás Balmaceda en su exposición en las XXIX Jornadas de Investigación d ...

15 DE ABRIL DE 2026