Mendoza apuesta a tonificar su ecosistema biotecnológico con un plan de cinco años

La provincia prepara el terreno para acelerar la creación de empresas de base científica y ...

16 DE JUNIO DE 2025

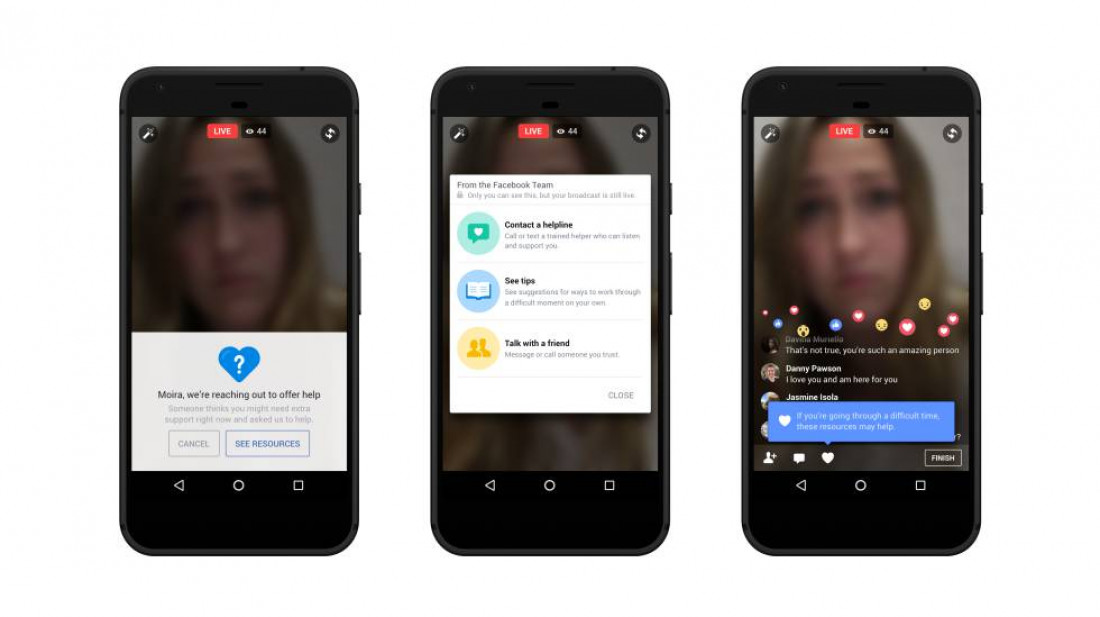

Gracias a la inteligencia artificial, la compañía puede actuar más rápido ante casos de personas que amenacen con quitarse la vida.

Facebook renueva su interfaz para facilitar que los usuarios, ayudados por el sistema de detección de inteligencia artificial de Facebook, informen sobre casos de riesgo de suicidio. Foto: El País.

Unidiversidad / Fuente: El País

Publicado el 29 DE NOVIEMBRE DE 2017

La nueva tecnología de detección proactiva que estrenó Facebook el lunes 27 rastreará todos los posts en busca de patrones relacionados con conductas suicidas. Este software, desarrollado para salvar vidas, permite al equipo humano de la compañía facilitar ayuda psicológica rápidamente a la persona en riesgo o a sus amigos y familiares al no necesitar que otros usuarios informen sobre estas conductas con antelación.

La tecnología, que ya estaba siendo probada en Estados Unidos, ya está activa en todo el mundo salvo en la Unión Europea, donde sus restrictivos reglamentos para salvaguardar la privacidad de los internautas lo impide. La inteligencia artificial de Facebook está entrenada para reconocer patrones en entradas escritas y videos en directo sirviéndose del chat. Respuestas como "¿Te encuentras bien?" o "¿Necesitas ayuda?" son buenos indicadores de que una persona puede estar en riesgo, dice la compañía. Según Facebook, se han dado casos en los que los algoritmos han detectado casos de riesgo desapercibidos para las personas.

Pero las máquinas son sólo una simple herramienta del equipo de moderadores. Su objetivo es agilizar la detección. Facebook señala que está dedicando más recursos para la prevención de suicidios y entrenando a sus empleados para lidiar con casos las 24 horas del día los siete días de la semana. Ya son más de 80 las organizaciones que apoyan la iniciativa, como save.org o la Red Nacional de Prevención del Suicidio estadounidense.

En los videos en directo, Facebook avisará a un revisor especializado y hará más prominentes las funciones a los espectadores para informar sobre un posible caso de riesgo de suicidio. Cuando un usuario informe sobre una situación de riesgo, la inteligencia artificial (IA) facilitará al moderador las partes claves del video y clasificará por prioridad todos los casos detectados para acelerar la acción donde más se necesita.

El despliegue es global porque Facebook cuenta con recursos locales, incluyendo líneas telefónicas de ayuda y comunicación con las autoridades cercanas. El moderador puede contactar con profesionales, familiares o amigos del usuario en riesgo.

Para Facebook, el despliegue de este tipo de funciones es de vital importancia para construir una comunidad más segura y para conseguir paliar los errores cometidos en el pasado con la retransmisión de suicidios en directo o el impacto en las elecciones estadounidenses y la difusión de noticias falsas.

Rastrear patrones de actividad puede salvar vidas, pero también preocupar a usuarios y organizaciones que temen que ese seguimiento pueda ser empleado para otros menesteres. Los pioneros de la red social, como Roger MacNamee, han criticado abiertamente el uso de la tecnología para persuadir a usuarios con fines propagandísticos.

"El uso malicioso de la IA será un riesgo siempre, por lo que es importante establecer buenas prácticas hoy para sopesar el balance entre la trata masiva de datos y su utilidad, teniendo en cuenta siempre el sesgo humano que pueden arrastrar las máquinas", dice Alex Stamos, jefe de seguridad informática de Facebook.

tecnología, redes sociales, facebook, conductas suicidas, prevención, inteligencia artificial,

La provincia prepara el terreno para acelerar la creación de empresas de base científica y ...

16 DE JUNIO DE 2025

Rafael Fernandez, investigador del Instituto de Ciencias Básicas (Conicet-UNCUYO), fue reconocido ...

05 DE MAYO DE 2025

Integran la empresa de base tecnológica ExoMas. Obtuvieron buenos resultados sobre modelos celulare ...

15 DE ABRIL DE 2025